引言:应对服务器拥堵,本地部署 DeepSeek-R1 成新趋势

随着 DeepSeek-R1 模型的爆火,官网频繁出现 “服务器繁忙” 提示,严重影响用户体验。本文为您提供一站式解决方案,通过Ollama 本地部署 + Cherry Studio 可视化客户端,实现低延迟、高稳定性的 DeepSeek-R1 访问,同时支持知识库问答、多模态交互等进阶功能。

![图片[1]-DeepSeek-R1 本地化部署全攻略:Ollama+Cherry Studio 实现可视化访问教程 - 搜源站-搜源站](https://www.souyuanzhan.com/wp-content/uploads/2025/04/2ab3f0adfe20250401124721-1024x590.webp)

一、DeepSeek-R1 技术优势与行业地位

DeepSeek-R1 由中国团队研发,采用671B 超大参数量和强化学习训练,在数学推理、代码生成等任务中性能对标 OpenAI GPT-4o,且开源模型权重,支持私有化部署。2025 年 1 月,其在 Arena 基准测试中位列全类别大模型第三,并与 GPT-4o 并列风格控制类第一。目前已部署于龙岗政务外网、QQ 音乐等场景,成为国产 AI 的标杆产品。

二、本地化部署方案:Ollama+Cherry Studio 实战指南

1. 工具准备

- Ollama:轻量级模型服务器,支持 DeepSeek-R1 系列模型本地运行。

- Cherry Studio:多模型聚合客户端,提供可视化交互界面,支持 Windows、Mac、Linux 系统。

下载地址:Cherry Studo 官方下载

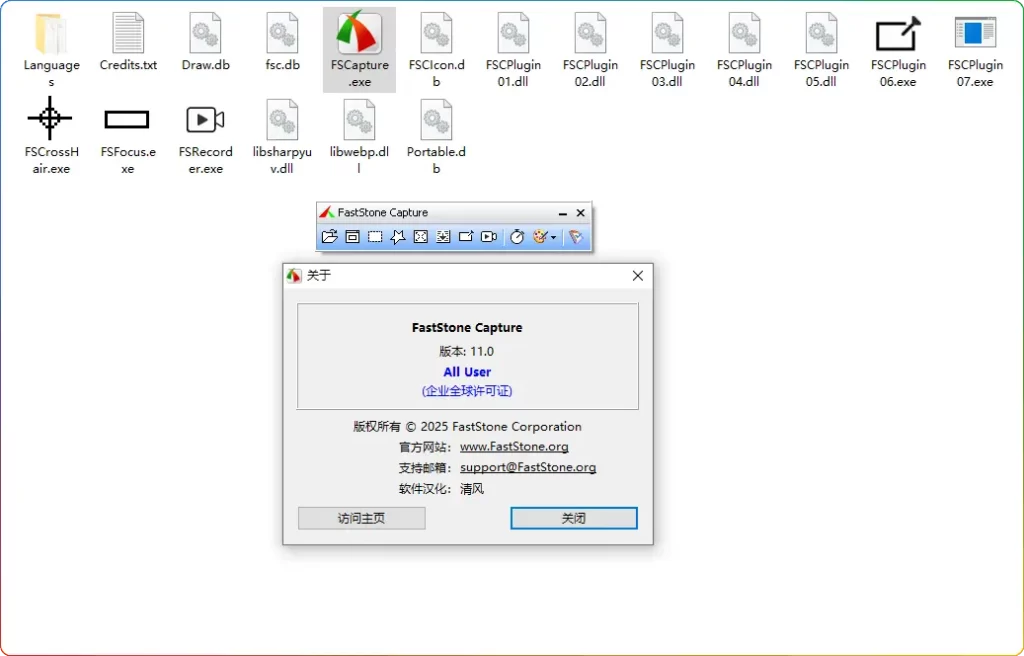

2. 部署步骤

Step 1:安装 Ollama 并加载模型

- 访问Ollama 官网下载对应系统版本。

- 运行命令行,输入模型加载指令(如

ollama run deepseek-r1),根据硬件选择1.5B 至 70B不同版本。

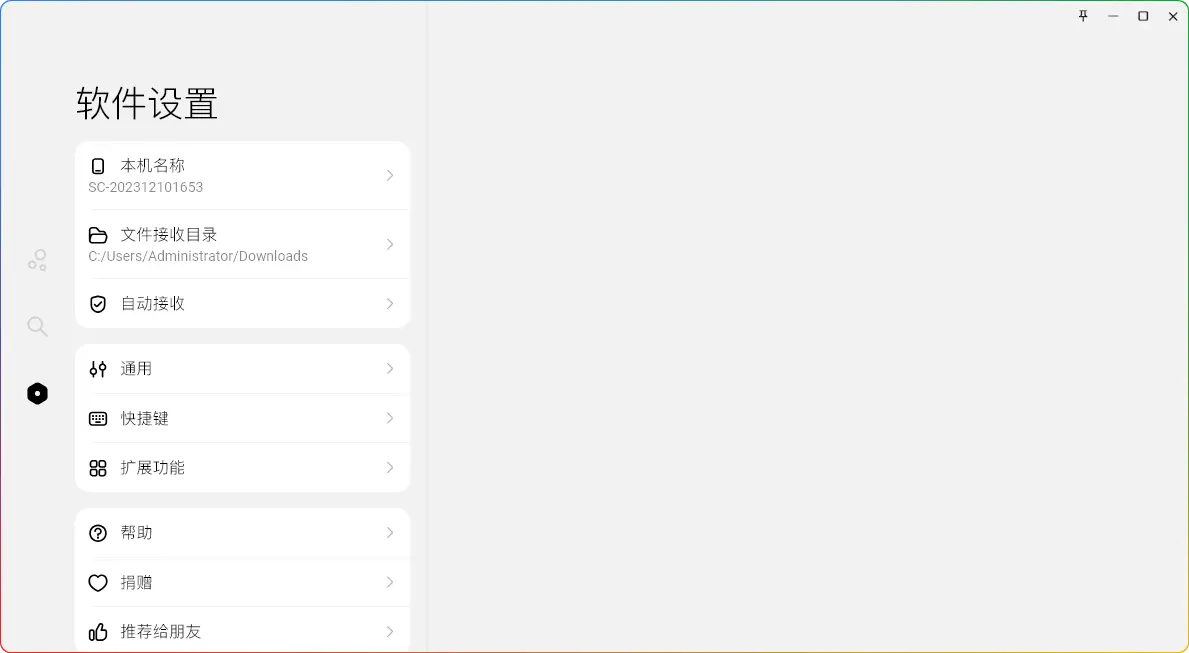

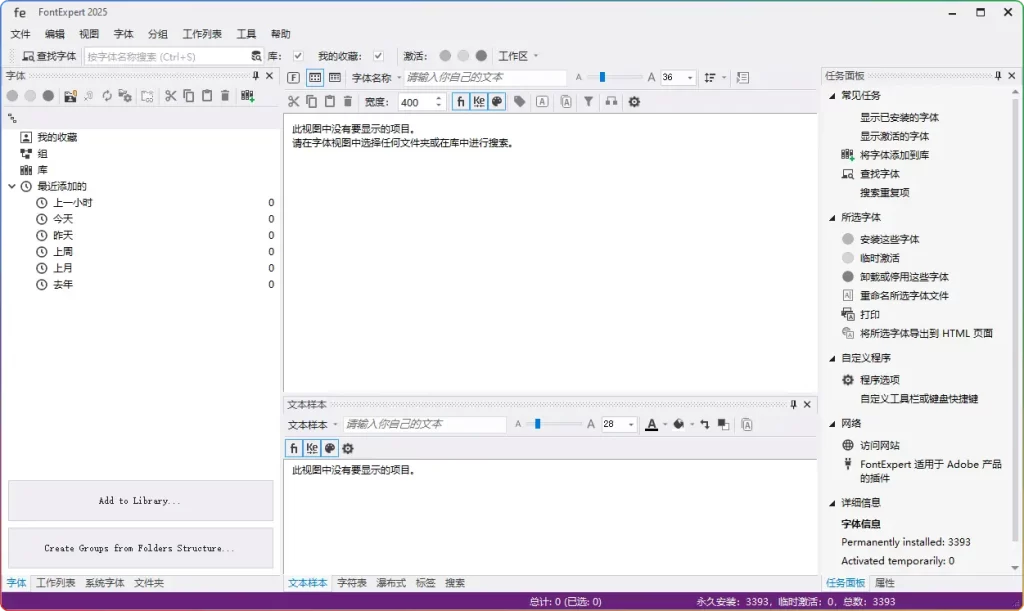

Step 2:配置 Cherry Studio

- 打开 Cherry Studio,点击左下角设置→模型服务→Ollama,开启服务并添加本地部署的 DeepSeek-R1。

- 若需切换模型,进入默认模型菜单调整配置。

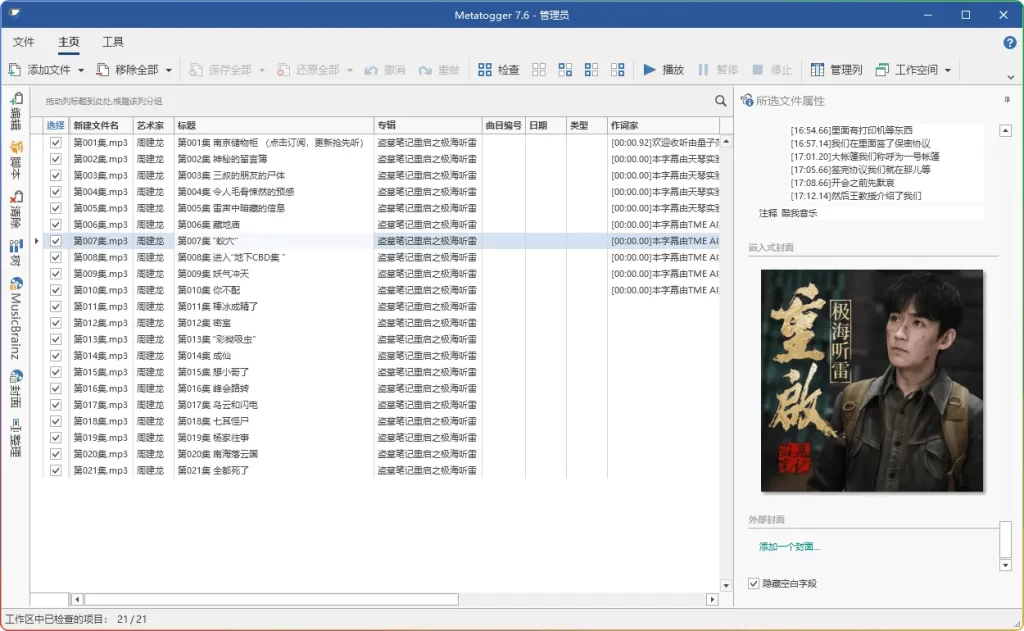

Step 3:体验对话与知识库功能

- 在对话助手中直接与 DeepSeek-R1 交互,支持长文本生成与复杂推理。

- 通过知识库功能上传文档(PDF/Word 等),实现基于本地数据的问答。

三、替代方案:API 调用与第三方平台访问

若本地部署条件有限,可通过以下方式快速接入 DeepSeek-R1:

1. 硅基流动 API

- 注册硅基流动平台获取免费额度,生成 API 密钥。

- 在 Cherry Studio 中配置硅基流动 API,选择

Deepseek-ai/DeepSeek-R1模型,支持手机端访问。

2. 火山引擎与腾讯云

- 火山引擎:提供 50 万 Token 免费额度,模型响应速度快,需自定义 API 配置。

- 腾讯云:通过 HAI 服务一键部署,支持高并发调用,适合企业级应用。

3. 直接访问平台

- 国家超算互联网:提供蒸馏版 DeepSeek-R1,支持在线推理与模型定制。

- 360 纳米 AI 搜索:集成满血版模型,手机端可直接使用。

四、行业应用与未来展望

DeepSeek-R1 已在政务、金融、教育等领域落地,例如:

- 深圳龙岗区通过昇腾服务器部署全尺寸模型,实现政务信创化。

- QQ 音乐集成该模型,优化歌曲推荐与音乐知识问答。

未来,随着国产算力适配(如华为昇腾、海光 DCU)的推进,DeepSeek-R1 将进一步降低部署门槛,推动 AI 技术普惠。

结语:选择适合方案,解锁 DeepSeek-R1 强大能力

无论是追求极致性能的本地部署,还是便捷高效的 API 调用,DeepSeek-R1 均提供了灵活的解决方案。通过 Cherry Studio 等工具,用户可轻松实现私有化对话、知识库构建等功能,摆脱服务器拥堵困扰。

立即行动:点击下方下载 Cherry Studio,开启你的 DeepSeek-R1 本地部署之旅!

下载地址

https://cloud.siliconflow.cn/i/9VTziPIQ

暂无评论内容